*Datos actualizados por última vez: 2026-04-27 00:02 (UTC+8)

A fecha de 2026-04-27 00:02, Arm Holdings (ARM) tiene un precio de €200,02, con una capitalización de mercado total de €212,96B, un ratio P/E de 141,57 y un rendimiento por dividendo de 0,00%. Hoy, el precio de la acción ha oscilado entre €179,80 y €202,98. El precio actual está 11,26% por encima del mínimo del día y 1,45% por debajo del máximo del día, con un volumen de trading de 20,48M. Durante las últimas 52 semanas, ARM ha cotizado entre €85,41 y €202,97, y el precio actual está a -1,45% del máximo de las últimas 52 semanas.

Estadísticas clave de ARM

Sobre ARM

Más información sobre Arm Holdings (ARM)

Artículos de Gate Learn

Análisis de acciones de ARM: Oportunidades de inversión y riesgos ante el auge de la IA

La cotización de ARM continúa al alza tras el último impulso de la inteligencia artificial, si bien las inquietudes sobre una valoración excesiva permanecen. En este artículo, te ofrecemos un análisis sobre las perspectivas de inversión de ARM con el objetivo de respaldar tu proceso de decisión financiera.

2025-09-19

Arm Stock: ¿Puede la innovación en IA llevar a este líder de semiconductores a nuevos niveles?

Arm Holdings desempeña un papel clave en la industria mundial de semiconductores, garantizando ingresos estables mediante su exclusivo modelo de negocio de licencias.

2025-11-03

Entender las acciones de ARM: ¿Podrá este fabricante de chips convertirse en el próximo gran referente en la era de la inteligencia artificial?

Este artículo empieza analizando la cotización de ARM, y examina cómo las estrategias de inteligencia artificial (AI) y de semiconductores de ARM afectan al precio de sus acciones. Además, integra la estrategia de asignación de capital de SoftBank y las expectativas del mercado para brindar a los nuevos inversores un marco de inversión transparente.

2025-10-15

Preguntas frecuentes sobre Arm Holdings (ARM)

¿A qué precio cotiza hoy Arm Holdings (ARM) hoy?

¿Cuáles son los precios máximo y mínimo de 52 semanas para Arm Holdings (ARM)?

¿Cuál es el ratio precio-beneficio (P/E) de Arm Holdings (ARM) y qué indica?

¿Cuál es la capitalización de mercado de Arm Holdings (ARM)?

¿Cuál es el beneficio por acción (BPA) del trimestre más reciente de Arm Holdings (ARM)?

¿Deberías comprar o vender Arm Holdings (ARM) ahora?

¿Qué factores pueden afectar el precio de las acciones de Arm Holdings (ARM)?

¿Cómo comprar acciones de Arm Holdings (ARM)?

Aviso de riesgo

Aviso legal

Otros mercados de trading

Últimas notícias sobre Arm Holdings (ARM)

Meta implementará millones de chips AWS Graviton para cargas de trabajo de IA

Mensaje de Gate News, 25 de abril — Amazon anunció el 24 de abril que Meta utilizará millones de chips AWS Graviton para cargas de trabajo de IA, lo que supone una victoria importante para AWS con sus procesadores ARM de fabricación propia. Los chips se utilizarán para la inferencia de IA y la computación general, en lugar de entrenamiento de modelos. El acuerdo abarca varios años y vale miles de millones de dólares, y Meta planea implementar decenas de millones de núcleos de procesador Graviton5. El anuncio llega después de la asociación cloud de seis años de Meta en Estados Unidos con $10 billion con Google Cloud en agosto de 2025, aunque la empresa sigue manteniendo relaciones con AWS y Microsoft Azure. El movimiento refleja cambios más amplios en la industria, ya que Amazon amplía su negocio de chips de IA a medida. En abril, Anthropic se comprometió a gastar US$100 billion durante más de 10 años en cargas de trabajo de AWS enfocadas en chips personalizados, lo que llevó a Amazon a invertir una cantidad adicional de US$5 billion en la startup.

2026-04-15 06:36La placa de desarrollo para PC basada en Arm N1 de chips de NVIDIA aparece, la entrada al mercado es inminente

Mensaje de noticias de Gate, 15 de abril — La placa de desarrollo N1 de NVIDIA, una (SoC) basada en Arm para PCs con Windows, co-desarrollada con MediaTek desde finales de 2024, ha salido a la luz en una plataforma china de compraventa de segunda mano. La placa incluye módulos de memoria SK Hynix LPDDR5X y tiene un precio de 9,999 yuanes (aproximadamente $1,370). Se cree que los chips N1/N1X son derivados del GB10 usado en la estación de trabajo de IA DGX Spark de NVIDIA, con velocidades de reloj, ancho de banda de memoria y recuentos de núcleos ajustados para entornos de portátiles. N1X integra 10 núcleos de CPU Arm Cortex-X925 de alto rendimiento, 10 núcleos Cortex-A725 de bajo consumo y núcleos de GPU Blackwell, con el objetivo de mejorar las capacidades de gaming y de creación de contenido en laptops con Windows basadas en Arm. El CEO de NVIDIA, Jensen Huang, mencionó por primera vez el chip N1 en septiembre del año pasado durante un anuncio con Intel, señalando que se usaría en DGX Spark y productos similares. Se espera que el chip se presente oficialmente durante GTC 2026, que se celebrará junto con Computex Taipei del 1 al 4 de junio. Se informa que Lenovo y Dell están preparando lanzamientos de productos relacionados.

2026-04-10 06:31SK Telecom se une a Arm y Rebellions para desarrollar una solución de inferencia para centros de datos de IA

Noticias del Gate News, 10 de abril, SK Telecom anunció que firmó un memorando de entendimiento (MOU) trilateral con la empresa británica de diseño de chips Arm y la startup surcoreana de chips de IA Rebellions, para desarrollar conjuntamente soluciones de servidores de inferencia para centros de datos de IA. Según el acuerdo, las tres partes combinarán la nueva CPU AGI de Arm y el chip de aceleración de IA RebelCard, que se espera que Rebellions lance en el tercer trimestre de este año, para desarrollar conjuntamente servidores de inferencia de IA, y realizarán pruebas y validación en los centros de datos de IA de SK Telecom. En particular, la CPU AGI de Arm está optimizada para entornos de inferencia de alta densidad y despliegues masivos de IA, mientras que RebelCard está diseñado específicamente para la inferencia de IA a gran escala.

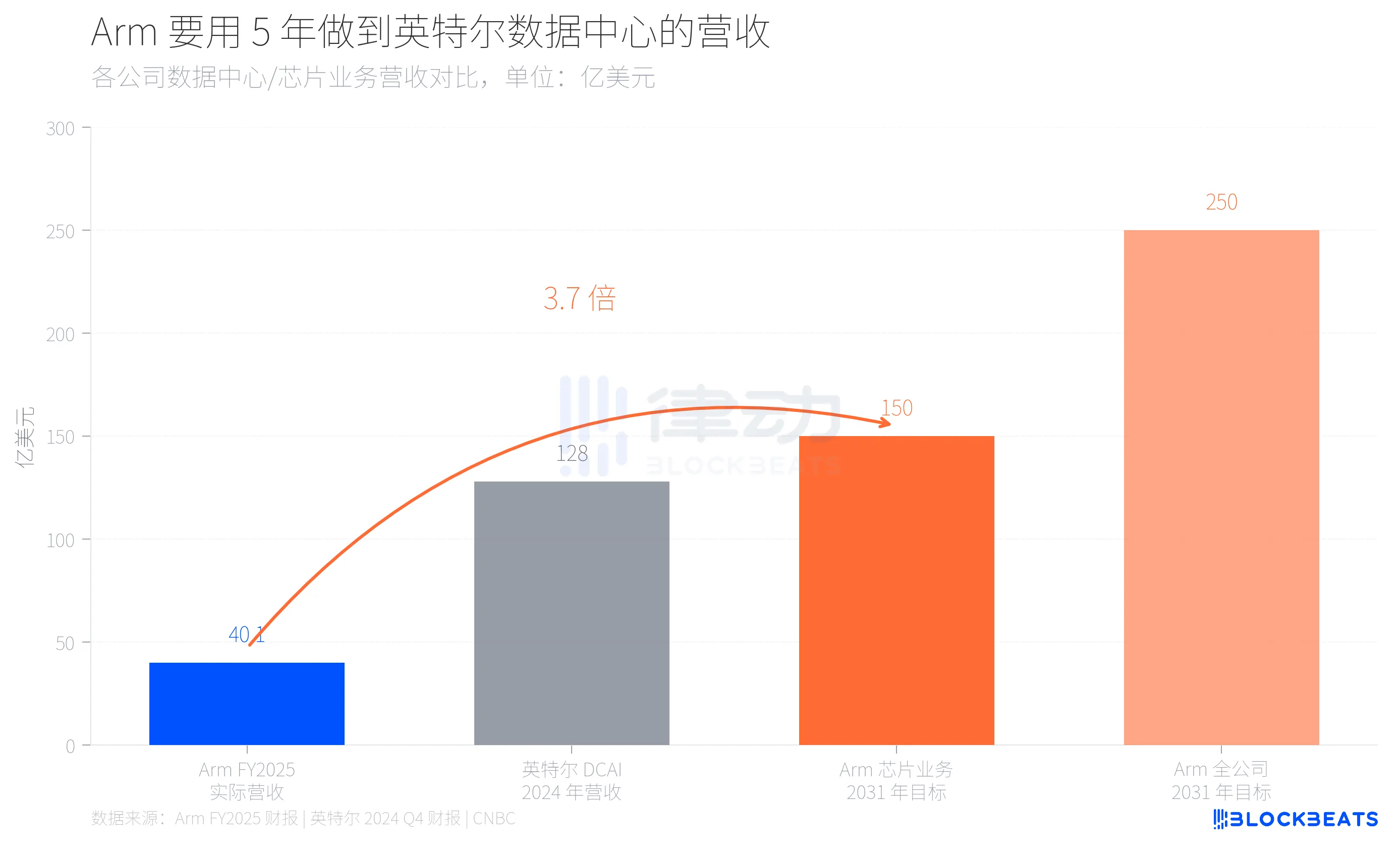

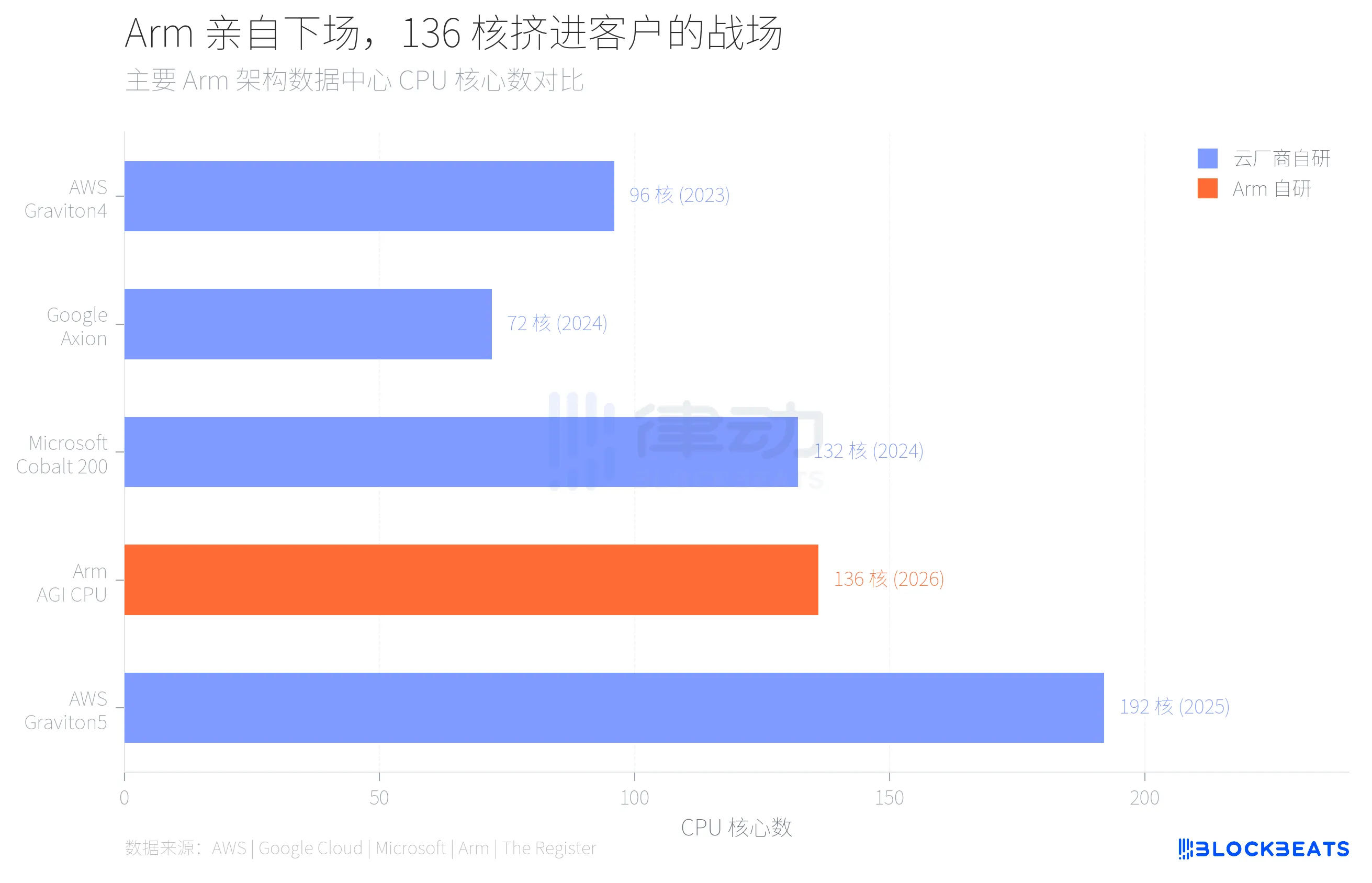

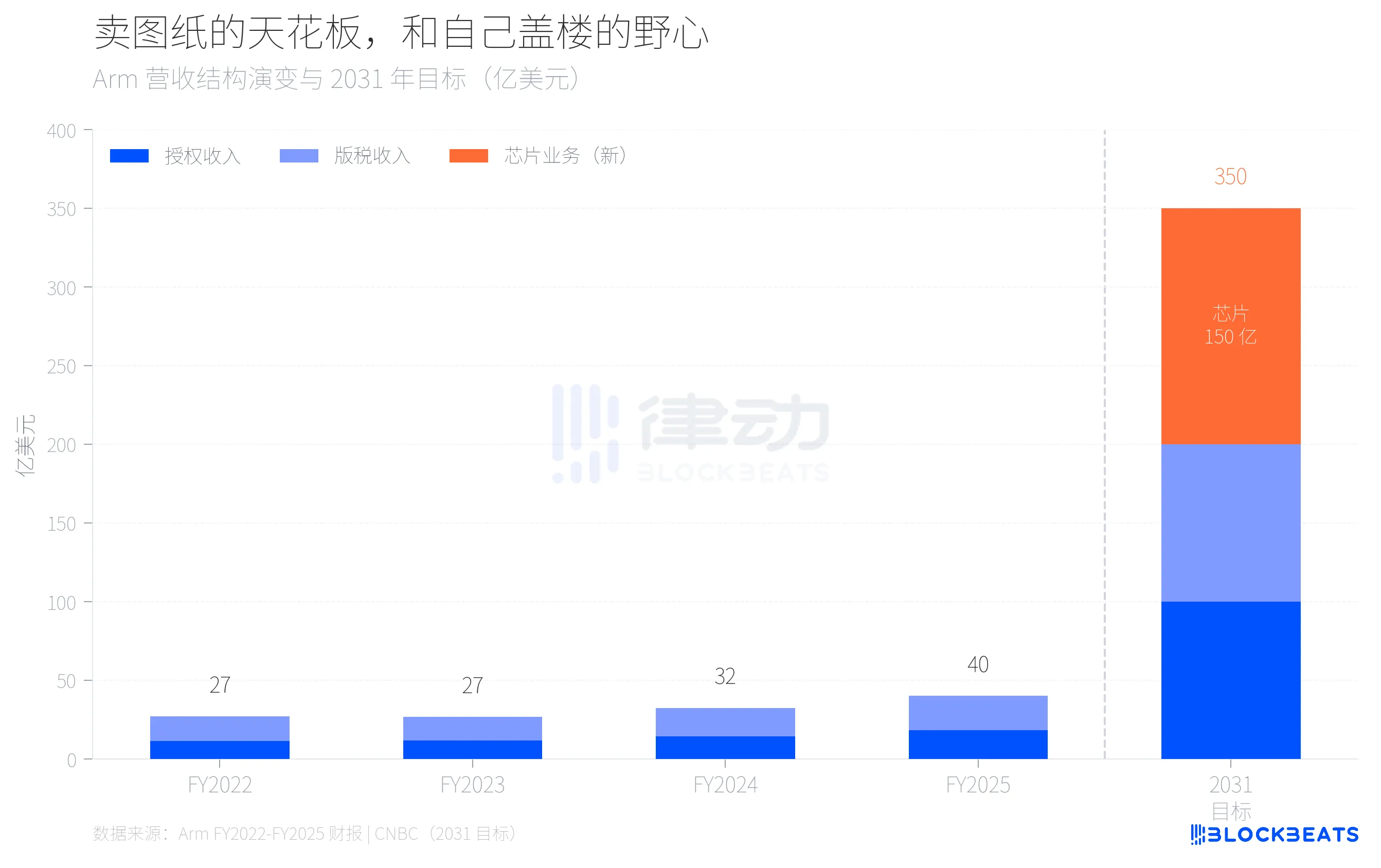

2026-03-25 08:05El intermediario más seguro de la industria de chips se adentró en el camino más peligroso

40 mil millones de dólares y 15 mil millones de dólares, lo que los separa no es una curva de crecimiento, sino una auto-ruptura del modelo de negocio. El 24 de marzo, Arm presentó en San Francisco su primer CPU de centro de datos desarrollado internamente en 35 años de historia. Este chip, llamado AGI CPU, cuenta con 136 núcleos Neoverse V3, proceso TSMC de 3 nm, TDP de 300W, Meta es su primer cliente y se desplegará a gran escala en el transcurso del año. También anunciaron colaboraciones con OpenAI, Cerebras, Cloudflare, SAP y SK Telecom. El CEO de Arm, Rene Haas, dio una serie de objetivos en la presentación, diciendo que para 2031, el negocio de chips alcanzará 15 mil millones de dólares en ingresos anuales, con una facturación total de la compañía de 25 mil millones de dólares y un beneficio por acción de 9 dólares. ¿Qué significa esta cifra? La compañía Arm en su año fiscal 2025 (hasta marzo de 2025) tendrá ingresos totales de 4,007 millones de dólares, según su informe anual, con ingresos por licencias de 1,839 millones y regalías de 2,168 millones, con un margen bruto del 97%. En otras palabras, una empresa con ingresos anuales de 4 mil millones de dólares planea en cinco años alcanzar un tamaño similar al de toda la división de centros de datos de Intel solo con un nuevo negocio. Según el informe financiero del cuarto trimestre de 2024 de Intel, su división DCAI (centros de datos y AI) generó 12,8 mil millones de dólares en todo el año.  De 40 a 150 mil millones, un salto de 3.7 veces, detrás de esto está el intento de Arm de transformarse de una simple empresa de licencias de IP en una híbrido que vende tanto diseños como productos terminados. Esto no tiene precedentes en la industria de chips. ¿Por qué Arm se arriesga? La respuesta está en su lista de clientes. En los últimos tres años, los principales clientes de centros de datos de Arm han estado haciendo lo mismo. Según datos públicos de AWS, Amazon ya ha migrado más del 50% de su capacidad EC2 a sus propios chips Graviton, con el más reciente Graviton5 alcanzando 192 núcleos. Google Cloud reveló que su chip Axion ya soporta más de 30,000 aplicaciones internas migradas, con una mejora en eficiencia energética del 80%. Microsoft también usa Cobalt 200 basado en la arquitectura Neoverse de Arm, con proceso de 3 nm de TSMC y 132 núcleos.  Estas empresas de la nube utilizan arquitecturas licenciadas de Arm, pero diseñan, fabrican y despliegan sus propios chips. Arm obtiene ingresos por licencias y regalías, no por la venta de chips. A medida que más capacidad de cálculo sea absorbida por estos chips propios, el techo de ingresos de Arm en centros de datos será cada vez más claro. Analizando la estructura de ingresos de los últimos cuatro años, el perfil de ese techo se vuelve más concreto. Según sus informes anuales, los ingresos totales de la compañía en FY2022 a FY2025 crecerán de 2,7 mil millones a 4 mil millones de dólares, con un crecimiento anual promedio de aproximadamente 14%. Las regalías aumentaron de 1,562 millones a 2,168 millones, y las licencias de 1,141 millones a 1,839 millones. La tasa de crecimiento de regalías, que en años anteriores fue menor, se ha estabilizado en torno al 20%, impulsada en gran parte por la actualización de la arquitectura Armv9 en dispositivos móviles, no en centros de datos.  Proyectando a esa tasa, incluso si los ingresos por licencias y regalías crecen alrededor del 20% anual, para 2031 solo alcanzarán aproximadamente 10 mil millones de dólares. Los otros 15 mil millones deberán provenir de un negocio que aún no existe. Esa es la lógica matemática detrás de que Arm decida fabricar sus propios chips. Elegir fabricar sus propios chips significa competir directamente con sus clientes. Una empresa que vende planos de construcción empieza a construir edificios por sí misma, mientras sus compradores ya llevan años construyendo con esos planos. Este es el verdadero contexto del AGI CPU de 136 núcleos. Según The Register, este chip tiene una frecuencia base de 3.2 GHz, máxima de 3.7 GHz, memoria DDR5 de 12 canales, con 6 GB/s de ancho de banda por núcleo, 96 canales PCIe 6.0 y soporte para CXL 3.0. Arm lo posiciona como “la base del poder de cómputo en la era de la IA agentic”, enfocado en tareas de programación y gestión de flujo de datos en inferencias de IA, sin competir directamente con GPU. El ritmo de cambio en la cuota de mercado también lo explica. Según Omdia, en 2025, los servidores con arquitectura Arm representarán aproximadamente el 21% del mercado global, con un crecimiento del 70%. Pero en los centros de datos a gran escala, esa proporción ya se acerca al 50%. La monopolización de 40 años de x86 no está colapsando, sino siendo reemplazada chip por chip. El riesgo de que Arm fabrique sus propios chips no está en la tecnología, sino en las relaciones. Meta está dispuesta a ser su primer cliente, en parte porque no tiene proyectos de chips propios tan maduros como Amazon o Google. Pero, ¿qué pensarán Amazon, Google y Microsoft? Cuando un proveedor empieza a competir por tu negocio, ¿seguirías confiando en que te otorgue la licencia de la arquitectura más importante? La apuesta de Arm es que el crecimiento del mercado de centros de datos será más rápido que el deterioro de las relaciones con sus clientes. Rene Haas cree firmemente que la demanda de CPU en la era de la IA será tan grande que la coexistencia de chips propios y licencias de arquitectura será posible. El objetivo de 15 mil millones de dólares es una valoración de esa creencia. 35 años vendiendo planos, por primera vez construyendo por cuenta propia. Los planos siguen vendiéndose, y también se construyen edificios, solo hay que ver si caben en el mismo terreno. Haz clic para conocer las oportunidades laborales en BlockBeats. **Únete a la comunidad oficial de BlockBeats:** Grupo de suscripción en Telegram: https://t.me/theblockbeats Grupo de Telegram: https://t.me/BlockBeats_App Cuenta oficial en Twitter: https://twitter.com/BlockBeatsAsia