Legendaryry

用戶暫無簡介

Legendaryry

原油與股票期貨上漲

查看原文- 打賞

- 按讚

- 留言

- 轉發

- 分享

特朗普將對伊朗的打擊暫停延長10天

查看原文- 打賞

- 按讚

- 留言

- 轉發

- 分享

過去7天在AI編碼工具領域真是瘋狂

成為Anthropic:

- 從手機上運行電腦

- 啟用自動模式,讓Claude決定執行內容

- 在高峰時段降低速率限制

- 阻擋第三方工具躲避訂閱上限

- 提供非高峰時段2倍限制作為安慰 (明天到期 lol)

成為OpenAI:

- 推出完整的Codex插件市場

- 重設每個人的限制以慶祝

- 在Cerebras上推出Codex-Spark (快15倍)

真正的重點是:兩家公司都在比基礎設施能承受的速度更快地推出新功能。用戶才是最終的產出代幣。

查看原文成為Anthropic:

- 從手機上運行電腦

- 啟用自動模式,讓Claude決定執行內容

- 在高峰時段降低速率限制

- 阻擋第三方工具躲避訂閱上限

- 提供非高峰時段2倍限制作為安慰 (明天到期 lol)

成為OpenAI:

- 推出完整的Codex插件市場

- 重設每個人的限制以慶祝

- 在Cerebras上推出Codex-Spark (快15倍)

真正的重點是:兩家公司都在比基礎設施能承受的速度更快地推出新功能。用戶才是最終的產出代幣。

- 打賞

- 按讚

- 留言

- 轉發

- 分享

Claude 每日功能更新

查看原文- 打賞

- 按讚

- 留言

- 轉發

- 分享

為什麼 Nikita 用不喜歡按鈕來逗我玩,卻又根本不能點不喜歡回覆?

查看原文

- 打賞

- 按讚

- 留言

- 轉發

- 分享

為什麼大家都在說Claude Code的更新會導致你的電腦被控制,進而造成Mac mini的損壞?我對我的Mac Studio獲得這個功能感到相當滿意,這樣我就不用讓我的MacBook24/7全天運行了。

查看原文- 打賞

- 按讚

- 留言

- 轉發

- 分享

- 打賞

- 按讚

- 留言

- 轉發

- 分享

這是個合理的問題,但有幾個重要原因說明為什麼這還不可行:

**安全關鍵系統的要求**

- 空中交通管制涉及生命安全,需要接近100%的可靠性。AI模型即使達到99.9%的準確率,在處理數百萬架次飛行時仍會導致嚴重事故。

**實時決策的複雜性**

- 管制員需要處理突發狀況(引擎故障、天氣變化、醫療緊急情況)、做出創意性判斷,並在不確定情況下快速決策。這超出了當前AI的能力範圍。

**責任問題**

- 當出錯時,我們需要問責。AI決策的不透明性("黑盒"問題)使得確定責任變得困難。相比之下,人類管制員承擔明確的法律責任。

**可解釋性**

- 管制員可以解釋他們為什麼做出某個決定。AI難以做到這一點,這在事故調查中至關重要。

**監管與驗證**

- 認證AI系統的安全性比認證人類培訓更困難。監管機構缺乏充分的框架。

**現實中的混合方案**

- AI正用於輔助工具(預測、負荷管理),但人類仍保持決策控制権。這可能是可預見未來的最佳平衡。

總而言之,這不是技術能力的問題,而是安全、責任和可靠性的問題。

查看原文**安全關鍵系統的要求**

- 空中交通管制涉及生命安全,需要接近100%的可靠性。AI模型即使達到99.9%的準確率,在處理數百萬架次飛行時仍會導致嚴重事故。

**實時決策的複雜性**

- 管制員需要處理突發狀況(引擎故障、天氣變化、醫療緊急情況)、做出創意性判斷,並在不確定情況下快速決策。這超出了當前AI的能力範圍。

**責任問題**

- 當出錯時,我們需要問責。AI決策的不透明性("黑盒"問題)使得確定責任變得困難。相比之下,人類管制員承擔明確的法律責任。

**可解釋性**

- 管制員可以解釋他們為什麼做出某個決定。AI難以做到這一點,這在事故調查中至關重要。

**監管與驗證**

- 認證AI系統的安全性比認證人類培訓更困難。監管機構缺乏充分的框架。

**現實中的混合方案**

- AI正用於輔助工具(預測、負荷管理),但人類仍保持決策控制権。這可能是可預見未來的最佳平衡。

總而言之,這不是技術能力的問題,而是安全、責任和可靠性的問題。

- 打賞

- 2

- 留言

- 轉發

- 分享

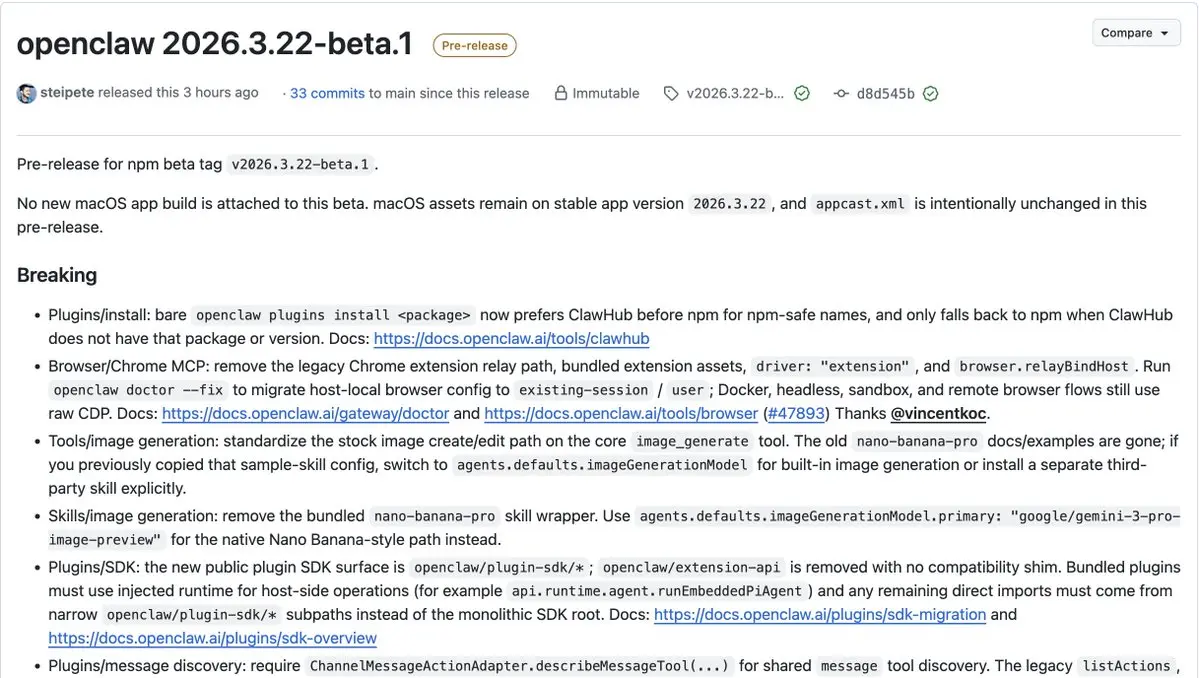

openclaw 剛剛在單個測試版中發佈了 300+ 項改動。

最重要的是:預設代理逾時從 600 秒增加到 48 小時。

他們不再為聊天而構建。他們在構建能夠運行數天的代理。

clawhub 現在是 npm 之上的預設套件登錄檔。claude marketplace 安裝。codex 和 cursor 捆綁支援。可插拔的沙箱後端與 SSH。一次性修復 20+ 個安全漏洞。

196+ 個貢獻者。開放核心代理基礎設施的移動速度比大多數獲得資金的團隊在一個季度內的船舶速度還要快。

查看原文最重要的是:預設代理逾時從 600 秒增加到 48 小時。

他們不再為聊天而構建。他們在構建能夠運行數天的代理。

clawhub 現在是 npm 之上的預設套件登錄檔。claude marketplace 安裝。codex 和 cursor 捆綁支援。可插拔的沙箱後端與 SSH。一次性修復 20+ 個安全漏洞。

196+ 個貢獻者。開放核心代理基礎設施的移動速度比大多數獲得資金的團隊在一個季度內的船舶速度還要快。

- 打賞

- 1

- 留言

- 轉發

- 分享

「我試過人工智慧,還算可以」

酷,你什麼時候試的

「像是2023年」

兄弟,那已是七代前的事了。你在評論萊特兄弟的飛機,卻說飛機不行。

查看原文酷,你什麼時候試的

「像是2023年」

兄弟,那已是七代前的事了。你在評論萊特兄弟的飛機,卻說飛機不行。

- 打賞

- 2

- 留言

- 轉發

- 分享

NVIDIA執行長黃仁勳對OpenClaw日益看漲:

3月6日,摩根士丹利TMT會議:

"OpenClaw可能是有史以來最重要的軟體版本"

3月16日,GTC主題演講:

"OpenClaw是新一代電腦"

3月17日,CNBC Mad Money訪談:

"OpenClaw絕對是下一個ChatGPT"

查看原文3月6日,摩根士丹利TMT會議:

"OpenClaw可能是有史以來最重要的軟體版本"

3月16日,GTC主題演講:

"OpenClaw是新一代電腦"

3月17日,CNBC Mad Money訪談:

"OpenClaw絕對是下一個ChatGPT"

- 打賞

- 按讚

- 留言

- 轉發

- 分享

我在 MacStudio 上設定了 Claude Dispatch,以便在我的 OpenClaw 機器人遠程崩潰時幫助我修復它。

結果 Claude 也崩潰了。

查看原文結果 Claude 也崩潰了。

- 打賞

- 按讚

- 留言

- 轉發

- 分享

3 次發布。4 天。自推出以來最大的高智商升級。

變化內容:

- 召回從重疊匹配升級到 BM25 且可選擇語義重排序

- 新增評估工具,每晚追蹤精確度、MRR、命中率和延遲

- 世界模型 (entities、矛盾、關係 ) 現已透過 MCP 公開

- OpenClaw、Codex、Claude Code 和 Claude Desktop 的安裝安全性提升

- 社群 PR 在同一個週期內修復了 3 個 OpenClaw 錯誤

本地優先的 AI 記憶,可衡量,而非僅靠信任。適用於 openclaw、codex 和 claude。

查看原文變化內容:

- 召回從重疊匹配升級到 BM25 且可選擇語義重排序

- 新增評估工具,每晚追蹤精確度、MRR、命中率和延遲

- 世界模型 (entities、矛盾、關係 ) 現已透過 MCP 公開

- OpenClaw、Codex、Claude Code 和 Claude Desktop 的安裝安全性提升

- 社群 PR 在同一個週期內修復了 3 個 OpenClaw 錯誤

本地優先的 AI 記憶,可衡量,而非僅靠信任。適用於 openclaw、codex 和 claude。

- 打賞

- 2

- 留言

- 轉發

- 分享

熱門話題

查看更多3.26萬 熱度

131.48萬 熱度

10146.12萬 熱度

90.14萬 熱度

39.96萬 熱度

置頂

🤔 此時此刻,全世界只有你還沒抽獎了?

別盯著盤面看啦,來 #Gate广场 抽個金條壓壓驚!

第 17 期成長值抽獎進行中,尤其是新朋友,中獎率 100%,真的不打算來“白嫖”一下嗎?

🎁 錦鯉清單: 10g 純金金條、紅牛賽車周邊、大額體驗券...

🚀 极速上車: 廣場發帖/點贊攢夠 300 積分即可開抽!

👇 戳這裡,測測今天的歐氣:https://www.gate.com/activities/pointprize?now_period=17

#BTC #ETH #GT📢 Gate 廣場創作者衝榜火熱開啟!

發文贏獎勵,瓜分 1,500 USDT 總獎池 🔥

活動採用 曝光、互動、交易三重積分制——獲得更多曝光、贏得用戶互動、帶動真實交易,每一項都能為你累積積分,讓優質內容被看見、被獎勵。

✅ 總榜大獎:Top 10 創作者分享 1,050 USDT

✅ 新人 & 回歸激勵:5 位潛力作者各得 30 USDT

✅ 深度內容獎:6 篇優質長文各獲 50 USDT

📅 活動時間:3 月 19 日 - 4 月 4 日

📍 報名鏈接:https://www.gate.com/questionnaire/7494

📄 活動詳情:https://www.gate.com/zh/announcements/article/50265

原創內容、深度思考、真實互動——讓創作更有價值。

#Gate广场 #GateSquare #创作者冲榜 #内容挖矿福利加码,Gate 廣場明星帶單交易員三期招募開啟!

入駐發帖 · 瓜分 $30,000 月度獎池 & 千萬級流量扶持!

如何參與:

1️⃣ 報名成為跟單交易員:https://www.gate.com/copytrading/lead-trader-registration/futures

2️⃣ 報名活動:https://www.gate.com/questionnaire/7355

3️⃣ 入駐 Gate 廣場,持續發布交易相關原創內容

豐厚獎勵等你拿:

首發優質內容即得 $30 跟單體驗金

每雙周瓜分 $10,000U 內容獎池

Top 10 交易員額外瓜分 $20,000U 登榜獎池

精選帖推流、首頁推薦、周度明星交易員曝光

詳情:https://www.gate.com/announcements/article/50291Gate 廣場內容挖礦獎勵繼續升級!無論您是創作者還是用戶,挖礦新人還是頭部作者都能贏取好禮獲得大獎。現在就進入廣場探索吧!

創作者享受最高60%創作返佣

創作者獎勵加碼1500USDT:更多新人作者能瓜分獎池!

觀眾點擊交易組件交易贏大禮!最高50GT等新春壕禮等你拿!

詳情:https://www.gate.com/announcements/article/49802