adsrekt

用户暂无简介

adsrekt

OPENCLAW新更新对现有厂商造成巨大冲击 🦞

当每个闭源API服务商都忙着添加防护措施并提高每个Token的收费时,openclaw发布了一个重大框架大修,简化了整个代理集成管道

这不是又一个包装器。不是又一个抽象控制权的"AI平台"。不是又一个你完全可以自己运行的功能的月度账单

这是为真正读文档的开发者打造的原生开源框架更新

> "开源总是落后两步"

这是那些没有看过发布说明的人的借口。openclaw简化了他们的实现层,这样你就不需要把4个不同的库连接在一起才能获得一个可工作的代理循环

老版本会让你在冗余逻辑链上浪费Token。

查看原文当每个闭源API服务商都忙着添加防护措施并提高每个Token的收费时,openclaw发布了一个重大框架大修,简化了整个代理集成管道

这不是又一个包装器。不是又一个抽象控制权的"AI平台"。不是又一个你完全可以自己运行的功能的月度账单

这是为真正读文档的开发者打造的原生开源框架更新

> "开源总是落后两步"

这是那些没有看过发布说明的人的借口。openclaw简化了他们的实现层,这样你就不需要把4个不同的库连接在一起才能获得一个可工作的代理循环

老版本会让你在冗余逻辑链上浪费Token。

- 赞赏

- 点赞

- 评论

- 转发

- 分享

Codex 自动化已正式发布,手动管理代码库的日子现在成了可选项

设置模型、设置推理级别、选择工作树或现有分支——这不是包装器,这是对代理思维方式和代码写入位置的细粒度控制

可复用模板意味着你只需构建一次工作流,然后让它每天运行代码库简报、问题分类、PR 评论后续,而你可以专注于真正重要的事情

没人谈论的部分——你现在可以对整个 Codex 应用进行主题设置,并与其他开发者导入或共享主题,这听起来很小,直到你意识到你每天要盯着这个东西 9 小时

不是聊天机器人皮肤。不是提示词游乐场。一个真正的操作员环境,你可以在推理层和视觉层都进行调整。

查看原文设置模型、设置推理级别、选择工作树或现有分支——这不是包装器,这是对代理思维方式和代码写入位置的细粒度控制

可复用模板意味着你只需构建一次工作流,然后让它每天运行代码库简报、问题分类、PR 评论后续,而你可以专注于真正重要的事情

没人谈论的部分——你现在可以对整个 Codex 应用进行主题设置,并与其他开发者导入或共享主题,这听起来很小,直到你意识到你每天要盯着这个东西 9 小时

不是聊天机器人皮肤。不是提示词游乐场。一个真正的操作员环境,你可以在推理层和视觉层都进行调整。

- 赞赏

- 1

- 评论

- 转发

- 分享

你的 .env 文件正被传送到一个类似的域名,你可能是自己输入了 cargo add

socket security 刚刚发现自2026年2月以来,有5个恶意的 rust crate 位于 io 上——chrono_anchor、dnp3times、time_calibrator、time_calibrators、time-sync

它们都伪装成时间工具。它们都冒充 io。它们都会回拨到 timeapis[.]io——只差一个字母

整个载荷只做一件事。读取你的 .env 文件。获取其中的每个秘密。然后将其发送到攻击者控制的域名

这不是零日漏洞,也不是内核漏洞。只是一种看起来像你在凌晨1点会随意添加的 crate

> “我的依赖都很流行且经过验证”

这些 crate 模仿受信任库的命名模式。chrono_anchor 就在你自动补全的 chrono 旁边。这就是整个把戏。

查看原文socket security 刚刚发现自2026年2月以来,有5个恶意的 rust crate 位于 io 上——chrono_anchor、dnp3times、time_calibrator、time_calibrators、time-sync

它们都伪装成时间工具。它们都冒充 io。它们都会回拨到 timeapis[.]io——只差一个字母

整个载荷只做一件事。读取你的 .env 文件。获取其中的每个秘密。然后将其发送到攻击者控制的域名

这不是零日漏洞,也不是内核漏洞。只是一种看起来像你在凌晨1点会随意添加的 crate

> “我的依赖都很流行且经过验证”

这些 crate 模仿受信任库的命名模式。chrono_anchor 就在你自动补全的 chrono 旁边。这就是整个把戏。

- 赞赏

- 点赞

- 评论

- 转发

- 分享

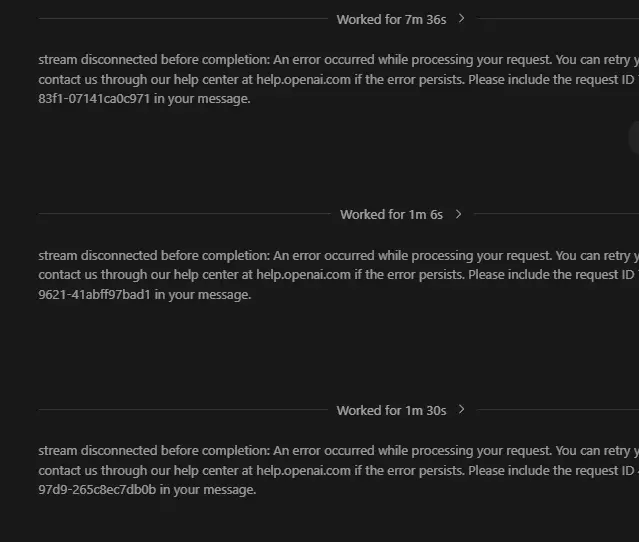

Codex 今天工作不正常,GPT 5.4 服务器过载,我是唯一遇到这个问题的人吗?

查看原文

- 赞赏

- 点赞

- 评论

- 转发

- 分享

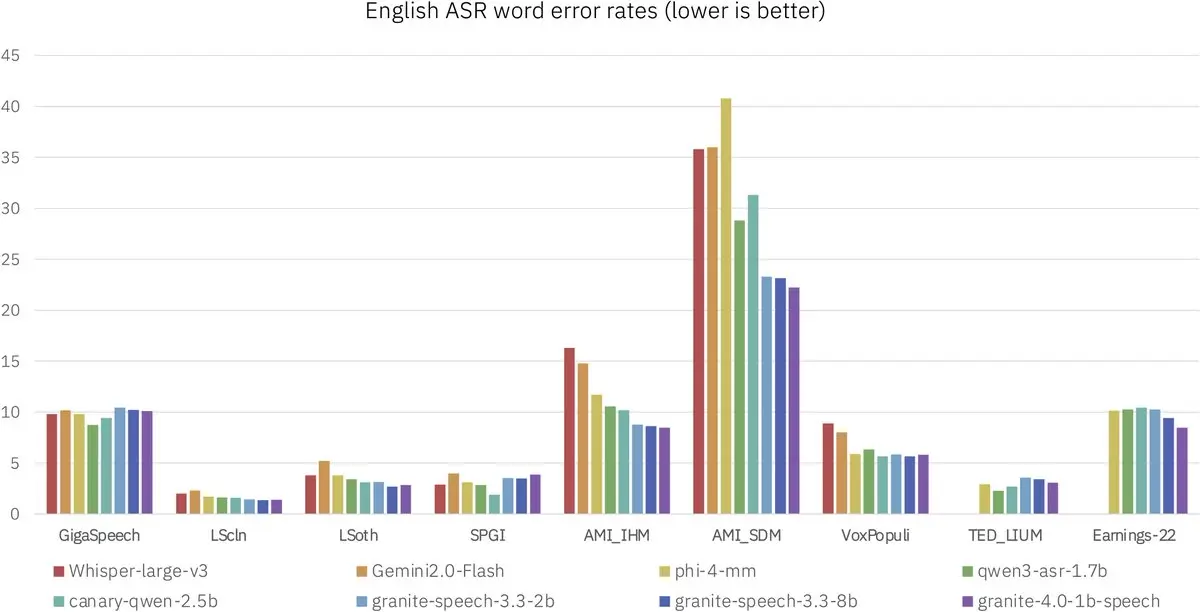

有人在苹果手表上运行了一个语音模型。不是玩具演示。Granite 4.0 1B 语音模型在OpenASR排行榜上排名第一。它的精彩之处在于:• 1B参数——只有Granite 3.3 2B模型的一半大小 • 英语转录准确率高于更大模型 • 采用推测解码,在微型硬件上实现更快推理 • 支持6种语言——英语、法语、德语、西班牙语、葡萄牙语、日语 • 关键词列表偏置,确保能正确识别名字和缩写 没有人提到的部分:你每个月都在为Whisper API调用付费,而一个比前一代模型小一半的模型却在你的手腕设备上表现优异。这不是简单的优化。这意味着边缘语音应用的整个成本结构正在崩溃。模型更小,准确率更高。完全无需云端依赖。

查看原文

- 赞赏

- 2

- 评论

- 转发

- 分享

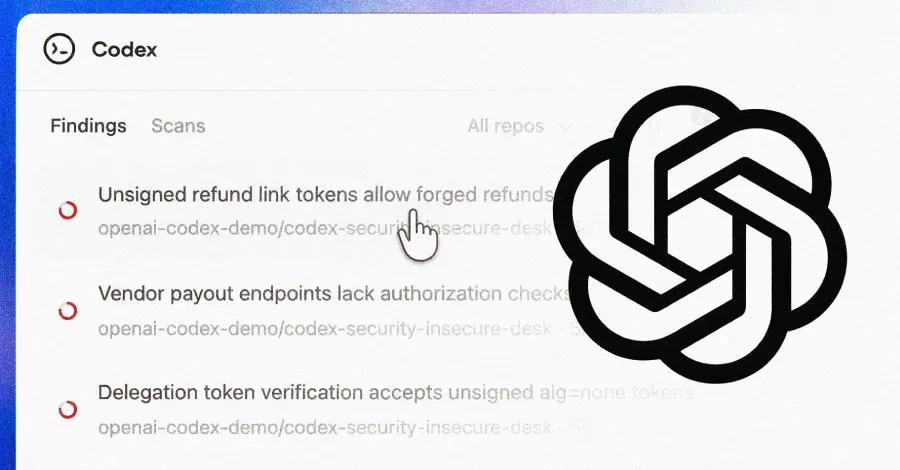

OpenAI在30天内扫描了120万次提交

他们发现了10,561个高严重性漏洞,792个关键漏洞。

在你现在可能依赖的项目中

OpenSSH、GnuTLS、Chromium、Libssh、PHP。

这些都不是业余仓库。这些是你整个技术栈所依赖的基础。而人类多年来一直错过这些问题。

Codex安全不仅仅是标记像你的linter突然崩溃的噪音。它在整个项目中构建上下文,验证发现,然后提出实际的修复方案。

这就是“你会忽略的4000个警告”和“OpenSSH中的这个特定函数让攻击者可以做一些你不想让它做的事情”之间的区别。

在ChatGPT专业版/企业版/商务版上免费试用一个月。目前处于研究预览阶段。

诚实地问一句——你真的相信你当前的CI管道能捕捉到代理刚刚在OpenSSH中发现的问题吗?

查看原文他们发现了10,561个高严重性漏洞,792个关键漏洞。

在你现在可能依赖的项目中

OpenSSH、GnuTLS、Chromium、Libssh、PHP。

这些都不是业余仓库。这些是你整个技术栈所依赖的基础。而人类多年来一直错过这些问题。

Codex安全不仅仅是标记像你的linter突然崩溃的噪音。它在整个项目中构建上下文,验证发现,然后提出实际的修复方案。

这就是“你会忽略的4000个警告”和“OpenSSH中的这个特定函数让攻击者可以做一些你不想让它做的事情”之间的区别。

在ChatGPT专业版/企业版/商务版上免费试用一个月。目前处于研究预览阶段。

诚实地问一句——你真的相信你当前的CI管道能捕捉到代理刚刚在OpenSSH中发现的问题吗?

- 赞赏

- 点赞

- 评论

- 转发

- 分享

你交付了5个打磨过的演示版本。你没有任何用户。产品本身不是问题。

问题出在营销。

我知道,因为我在盯着一个空白的写作框数月后,建立了fcksmm,而我的项目都积灰尘。

> “如果我做得足够好,人们会找到它”

这是在公开社区中最昂贵的谎言。每天都有优秀的产品悄无声息地死去。

营销不是表演。它是分发工程。它和你的数据库、认证层一样,是技术栈的一部分。

你不会在没有错误处理的情况下交付产品,那么你为什么要在没有一篇帖子解释你做了什么的情况下交付呢?

@fcksmm_ 学习你如何从原始笔记中写作,并将它们转化为听起来像你的帖子。不是LinkedIn的风格。不是GPT的废话。是你的声音。

不是模板。不是提示链。

查看原文问题出在营销。

我知道,因为我在盯着一个空白的写作框数月后,建立了fcksmm,而我的项目都积灰尘。

> “如果我做得足够好,人们会找到它”

这是在公开社区中最昂贵的谎言。每天都有优秀的产品悄无声息地死去。

营销不是表演。它是分发工程。它和你的数据库、认证层一样,是技术栈的一部分。

你不会在没有错误处理的情况下交付产品,那么你为什么要在没有一篇帖子解释你做了什么的情况下交付呢?

@fcksmm_ 学习你如何从原始笔记中写作,并将它们转化为听起来像你的帖子。不是LinkedIn的风格。不是GPT的废话。是你的声音。

不是模板。不是提示链。

- 赞赏

- 1

- 评论

- 转发

- 分享

OpenAI 发布了 GPT-5.4 Pro,完全没有安全评估

没有系统卡,没有公开风险评估,什么都没有。

这可能是目前在生物研究开发、网络攻防操作和自主计算方面最好的模型——他们就像发布补丁说明一样发布了它

这也不是第一次。GPT-5.2 Pro 也遵循了同样的模式。悄悄发布,没有文档,没有外部审查。他们以前也这样做过,没有人追究责任,所以他们又这样做了

OpenAI 现在发布的前沿模型的透明度甚至比在 Huggingface 上的周末微调还要低

如果你在构建基于 5.4 Pro 的系统或在任何涉及敏感领域的管道中部署它,当模型被推动时,你完全不知道它实际上能做什么。

查看原文没有系统卡,没有公开风险评估,什么都没有。

这可能是目前在生物研究开发、网络攻防操作和自主计算方面最好的模型——他们就像发布补丁说明一样发布了它

这也不是第一次。GPT-5.2 Pro 也遵循了同样的模式。悄悄发布,没有文档,没有外部审查。他们以前也这样做过,没有人追究责任,所以他们又这样做了

OpenAI 现在发布的前沿模型的透明度甚至比在 Huggingface 上的周末微调还要低

如果你在构建基于 5.4 Pro 的系统或在任何涉及敏感领域的管道中部署它,当模型被推动时,你完全不知道它实际上能做什么。

- 赞赏

- 1

- 评论

- 转发

- 分享

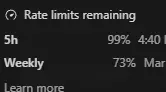

GPT 5.4 提示

停止启用 1百万上下文窗口。它还没有准备好。这是用户体验的表演,正在把你的构建烧得一干二净

我在我自己的三个项目中彻底测试了新模型。不是随意检查——是真正的生产工作

这里有一些没人告诉你的事情:

抽象任务理解能力显著提升。模型终于在你逐步说明之前理解你想做什么

但那个大家都在炒作的 1百万上下文窗口?不要碰它。它还不成熟。把你的上下文放到项目文件夹和项目设置里。模型实际上就是在那里读取

启用每项技能。每个工具。把它们都最大化。当模型拥有完整权限时,它的表现就像是另一个产品,而不是默认的精简版本

还有 xHigh 模式?那是个 TOKEN 火炉。看着它在执行相同任务时摧毁了我的余额,而标准模式却能正常处理

查看原文停止启用 1百万上下文窗口。它还没有准备好。这是用户体验的表演,正在把你的构建烧得一干二净

我在我自己的三个项目中彻底测试了新模型。不是随意检查——是真正的生产工作

这里有一些没人告诉你的事情:

抽象任务理解能力显著提升。模型终于在你逐步说明之前理解你想做什么

但那个大家都在炒作的 1百万上下文窗口?不要碰它。它还不成熟。把你的上下文放到项目文件夹和项目设置里。模型实际上就是在那里读取

启用每项技能。每个工具。把它们都最大化。当模型拥有完整权限时,它的表现就像是另一个产品,而不是默认的精简版本

还有 xHigh 模式?那是个 TOKEN 火炉。看着它在执行相同任务时摧毁了我的余额,而标准模式却能正常处理

- 赞赏

- 2

- 评论

- 转发

- 分享

停止构建你的想法。从你的市场进入策略(GTM)开始。

我今年发布了三个工具。那些实现了$5k 美元月经常性收入(MRR)的工具有一个共同点——我在写第一行代码之前就知道流量来自哪里。

那些失败的工具架构更好。

你手上现在有五个打磨完毕的演示,没有用户,没有月收入(MRR),你还在调整代理循环,而不是问一个问题——我的前50个用户来自哪里。

不是你的想法,不是你的技术栈,也不是你的多代理框架。

你的创业项目的生死取决于分发渠道。

现在就做一次资源审计,看看你已经拥有的资源:你的粉丝(X粉丝)、你的Discord、你的API额度、你的细分子Reddit,以及你从那个你放弃的项目中积累的邮件列表。

那就是你的市场进入策略(GTM),那是你的起跑线。

打造适合你已经能触达渠道的产品。

查看原文我今年发布了三个工具。那些实现了$5k 美元月经常性收入(MRR)的工具有一个共同点——我在写第一行代码之前就知道流量来自哪里。

那些失败的工具架构更好。

你手上现在有五个打磨完毕的演示,没有用户,没有月收入(MRR),你还在调整代理循环,而不是问一个问题——我的前50个用户来自哪里。

不是你的想法,不是你的技术栈,也不是你的多代理框架。

你的创业项目的生死取决于分发渠道。

现在就做一次资源审计,看看你已经拥有的资源:你的粉丝(X粉丝)、你的Discord、你的API额度、你的细分子Reddit,以及你从那个你放弃的项目中积累的邮件列表。

那就是你的市场进入策略(GTM),那是你的起跑线。

打造适合你已经能触达渠道的产品。

- 赞赏

- 点赞

- 评论

- 转发

- 分享

新的 GPT 5.4 感觉棒极了

>gpt 5.3 codex 详细描述了她的动作,但最终生成了糟糕的代码

>gpt 5.2 完全没有描述,但表现更好

>5.4 - 结合了这些优点

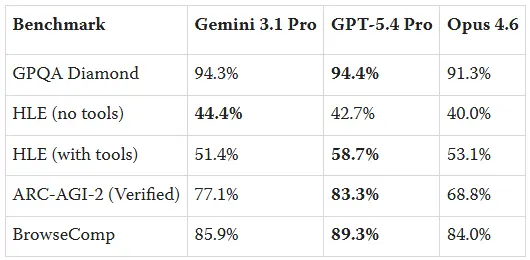

现在是 GPT 5.4 还是 Opus 4.6 ?

查看原文>gpt 5.3 codex 详细描述了她的动作,但最终生成了糟糕的代码

>gpt 5.2 完全没有描述,但表现更好

>5.4 - 结合了这些优点

现在是 GPT 5.4 还是 Opus 4.6 ?

- 赞赏

- 1

- 评论

- 转发

- 分享

你的AI代理现在拥有完全的root权限

只需一个幻觉命令

> sudo rm -rf /

这不是理论上的

代理循环会根据你无法控制的上下文窗口生成shell命令。模型不需要恶意。

它只需要出错一次。

查看原文只需一个幻觉命令

> sudo rm -rf /

这不是理论上的

代理循环会根据你无法控制的上下文窗口生成shell命令。模型不需要恶意。

它只需要出错一次。

- 赞赏

- 2

- 评论

- 转发

- 分享

你的手机比你的妻子更了解你。

用加密货币支付的临时号码没有历史记录,没有身份,没有束缚。

没有验证的自拍照。没有关联的银行账户。没有凌晨3点关于哪个交易所刚被传唤的焦虑。

查看原文用加密货币支付的临时号码没有历史记录,没有身份,没有束缚。

没有验证的自拍照。没有关联的银行账户。没有凌晨3点关于哪个交易所刚被传唤的焦虑。

- 赞赏

- 1

- 评论

- 转发

- 分享

“Python ‘为你管理内存’”的神话导致你的代理在运行4小时后OOM

上个月并行运行了24个多代理,消耗的tokens是单个会话的10倍,却没有任何可用输出

真正的问题并不是tokens,而是没人关注的内存

Python使用引用计数加循环垃圾回收。听起来没问题,直到你通过C扩展加载numpy数组,而这些扩展没有正确递减引用。那些对象永远不会被回收。它们就那样静静地存在,逐渐增长

每处理100个tokens的上下文,你的长时间运行的代理就会进行一次tensor分配,可能不会释放。将此乘以24个并发会话,你每天可能会泄漏400MB的内存

> 只需增加更多RAM

是的,这意味着每月花费3万美元的计算资源,来弥补tracemalloc在10分钟内就能捕获的问题

查看原文上个月并行运行了24个多代理,消耗的tokens是单个会话的10倍,却没有任何可用输出

真正的问题并不是tokens,而是没人关注的内存

Python使用引用计数加循环垃圾回收。听起来没问题,直到你通过C扩展加载numpy数组,而这些扩展没有正确递减引用。那些对象永远不会被回收。它们就那样静静地存在,逐渐增长

每处理100个tokens的上下文,你的长时间运行的代理就会进行一次tensor分配,可能不会释放。将此乘以24个并发会话,你每天可能会泄漏400MB的内存

> 只需增加更多RAM

是的,这意味着每月花费3万美元的计算资源,来弥补tracemalloc在10分钟内就能捕获的问题

- 赞赏

- 点赞

- 评论

- 转发

- 分享

你的AI是一个黑箱,这就是为什么它会耗尽你的钱包

机械可解释性是你如何打开一个大型语言模型(LLM)并映射其内部实际电路的方法

不是凭感觉测试

也不是“看起来有效”

是对模型实现逻辑的实际神经元级追踪

现在有96%的流量访问你的端点是机器人在读取原始HTML

你的模型正在做出你无法审计、无法追踪、无法解释的决策

而你却让它掌控真正资本的钥匙

企业AI安全团队都不理解自己的模型是如何工作的

他们用RLHF包裹模型并称之为对齐

那不是真正的安全,那是营销

真正的挑战在于规模——数十亿参数,而我们目前只能解释微小的电路

但这些微小电路告诉你一切

哪些神经元在价格数据上会激活

哪些神经元会完全覆盖你的RAG上下文

查看原文机械可解释性是你如何打开一个大型语言模型(LLM)并映射其内部实际电路的方法

不是凭感觉测试

也不是“看起来有效”

是对模型实现逻辑的实际神经元级追踪

现在有96%的流量访问你的端点是机器人在读取原始HTML

你的模型正在做出你无法审计、无法追踪、无法解释的决策

而你却让它掌控真正资本的钥匙

企业AI安全团队都不理解自己的模型是如何工作的

他们用RLHF包裹模型并称之为对齐

那不是真正的安全,那是营销

真正的挑战在于规模——数十亿参数,而我们目前只能解释微小的电路

但这些微小电路告诉你一切

哪些神经元在价格数据上会激活

哪些神经元会完全覆盖你的RAG上下文

- 赞赏

- 1

- 评论

- 转发

- 分享

Anthropic的收入运行速率刚刚达到$20 十亿

>$9 十亿预计在2025年底

>$14 十亿几周前

>$19 十亿现在

他们在几周内增加了$5 十亿

这不是增长,这是企业采纳的速度,除非同时签订大量API合同,否则看起来不合理。

查看原文>$9 十亿预计在2025年底

>$14 十亿几周前

>$19 十亿现在

他们在几周内增加了$5 十亿

这不是增长,这是企业采纳的速度,除非同时签订大量API合同,否则看起来不合理。

- 赞赏

- 点赞

- 评论

- 转发

- 分享

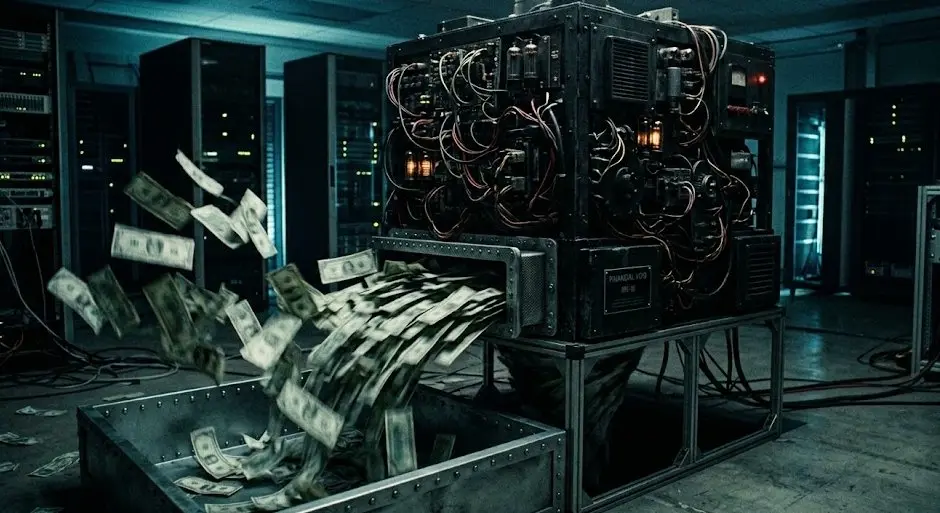

我在Codex中同时运行了24个多智能体会话

OpenAI,你在搞什么?

是单个标签页的10倍令牌

输出完全没有比专注于一个提示有任何提升

> “智能体之间协作的突现行为”

是的,突现的只是我的账单

你们付钱让智能体彼此交流,而不是产生任何东西

智能体A为智能体B总结,B再为C重格式化,C传给D,D输出的还是你本可以用一个干净的系统提示在14秒内得到的相同json

这不是架构,这是一个计算的剧场

查看原文OpenAI,你在搞什么?

是单个标签页的10倍令牌

输出完全没有比专注于一个提示有任何提升

> “智能体之间协作的突现行为”

是的,突现的只是我的账单

你们付钱让智能体彼此交流,而不是产生任何东西

智能体A为智能体B总结,B再为C重格式化,C传给D,D输出的还是你本可以用一个干净的系统提示在14秒内得到的相同json

这不是架构,这是一个计算的剧场

- 赞赏

- 1

- 评论

- 转发

- 分享

热门话题

查看更多30.55万 热度

52.31万 热度

4981.9万 热度

17.42万 热度

208.38万 热度

置顶

Gate Booster 第 4 期:发帖瓜分 1,500 $USDT

🔹 发布 TradFi 黄金福袋原创内容,可得 15 $USDT,名额有限先到先得

🔹 本期支持 X、YouTube 发布原创内容

🔹 无需复杂操作,流程清晰透明

🔹 流程:申请成为 Booster → 领取任务 → 发布原创内容 → 回链登记 → 等待审核及发奖

📅 任务截止时间:03月20日16:00(UTC+8)

立即领取任务:https://www.gate.com/booster/10028?pid=allPort&ch=KTag1BmC

更多详情:https://www.gate.com/announcements/article/50203🤖 寻找 Gate 广场 AI 测评官!$50,000 悬赏令发布!

发帖聊 AI,奖金拿到手软!新人首帖奖励翻倍,单帖最高 200U!

📝 立即报名:https://www.gate.com/questionnaire/7477

1️⃣ 发帖得红包,单帖最高 100U!

2️⃣ Top 体验分享官:带 #Gate广场AI测评官 聊技巧,赢国米球衣!

3️⃣ 收益率 PK 王:晒 AI 收益截图,赢 Gate 定制运动套装!

4️⃣ 深度好文额外加码 30U 每篇张榜公布!

💬 来 Gate 广场,把握行业新趋势:https://www.gate.com/post

时间:3/12 18:00 – 3/27 24:00 (UTC+8)

详情:https://www.gate.com/announcements/article/50206Gate 广场内容挖矿奖励继续升级!无论您是创作者还是用户,挖矿新人还是头部作者都能赢取好礼获得大奖。现在就进入广场探索吧!

创作者享受最高60%创作返佣

创作者奖励加码1500USDT:更多新人作者能瓜分奖池!

观众点击交易组件交易赢大礼!最高50GT等新春壕礼等你拿!

详情:https://www.gate.com/announcements/article/49802